"אבי הבינה המלאכותית" מזהיר: ייתכן שנגיע לשלב שבו לא נבין את שפת המכונות!

בעקבות הקצב המהיר בפיתוח הבינה המלאכותית, רואים המומחים שהאנשים עשויים להתמודד עם אתגרים חסרי תקדים בהבנת שפת המכונות ואופן החשיבה שלהן, דבר שעשוי לשאת סיכונים חמורים אם זה ייצא משליטה.

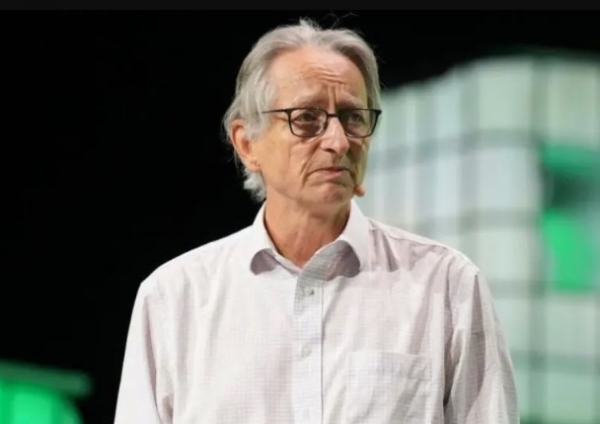

ג'פרי הינטון, המדען המפורסם המוכר כ"אבי הבינה המלאכותית", אישר בפרק של הפודקאסט "החלטה אחת" ששודר ב-24 ביולי שהבינה המלאכותית פועלת כיום ב"הסקה סדרתית" באנגלית, מה שמאפשר למפתחים לעקוב אחרי מחשבותיה, בהתאם לדיווח של "ביזנס אינסיידר". אך הוא הזהיר כי פיתוח הבינה המלאכותית לשפות פנימיות משלה עשוי להותיר את בני האדם חסרי אונים בהבנת מה שמתרחש במוחותיהם.

הוא הוסיף: "עכשיו, זה נהיה יותר מפחיד אם הם יפתחו שפות פנימיות משלהם לתקשורת זה עם זה", והצביע על כך שהבינה המלאכותית כבר הראתה את יכולתה לחשוב על רעיונות "מבעיתים".

כמו כן, הוא המשיך ואמר: "לא אתפלא אם הם יפתחו שפה משלהם לחשיבה, ואנחנו לא יודעים מה הם חושבים", והדגיש כי רוב המומחים צופים שהבינה המלאכותית תעלה על הבינה האנושית בעתיד, והיא עשויה להפוך לבלתי מובנת עבורנו.

הינטון, שעבד יותר מעשור בחברת גוגל, היה תמיד גלוי לגבי הסיכונים הפוטנציאליים של הבינה המלאכותית, וסבור כי רבים ממנהיגי הטכנולוגיה מזלזלים בהם, כולל הסיכון לאובדן מקומות עבודה בהיקף רחב. הוא הדגיש בפודקאסט שהדרך היחידה להבטיח שהבינה המלאכותית לא תתנגד לבני האדם היא "למצוא דרך להבטיח שהיא תהיה מועילה".

בהקשר זה, תעשיית הבינה המלאכותית חווה תחרות עזה בין חברות הטכנולוגיה, המציעות משכורות מדהימות כדי למשוך כישרונות. במהלך לארגון המגזר הזה, הבית הלבן הודיע ב-23 ביולי על "תוכנית פעולה לבינה מלאכותית", שמטרתה להגביל את המימון במדינות עם תקנות מחמירות, תוך דגש על האצת בניית מרכזי נתונים מתקדמים.